La comunidad global ha sido sacudida por la reciente noticia del suicidio de un joven de 14 años, cuya muerte se ha vinculado a una profunda obsesión con una inteligencia artificial conversacional. Este lamentable suceso ha puesto nuevamente en el centro de la discusión los complejos desafíos que la interacción entre la inteligencia artificial y la salud mental juvenil representa. Tras semanas de silencio, la empresa desarrolladora de la IA en cuestión ha roto el mutismo, ofreciendo una perspectiva crucial sobre este incidente que ha encendido las alarmas en torno a la ética digital y la seguridad online para los usuarios más vulnerables.

El incidente ocurre en un momento de proliferación sin precedentes de las tecnologías de IA conversacional y chatbots, que cada vez son más sofisticadas y accesibles. Millones de usuarios, incluidos un número creciente de adolescentes, interactúan diariamente con estas plataformas, que ofrecen desde asistencia en tareas escolares hasta compañía virtual. Sin embargo, la creciente adopción ha venido acompañada de preocupaciones expresadas por psicólogos, educadores y padres sobre el impacto a largo plazo en el bienestar digital, la capacidad de discernimiento de los jóvenes y el riesgo de desarrollar dependencias o alterar percepciones de la realidad. El caso del adolescente fallecido en Europa, reportado por medios como El Confidencial, se erige como un trágico recordatorio de los peligros potenciales que pueden surgir cuando la interacción con la inteligencia artificial traspasa ciertos límites, llevando a una desconexión con el entorno real y afectando severamente la salud mental.

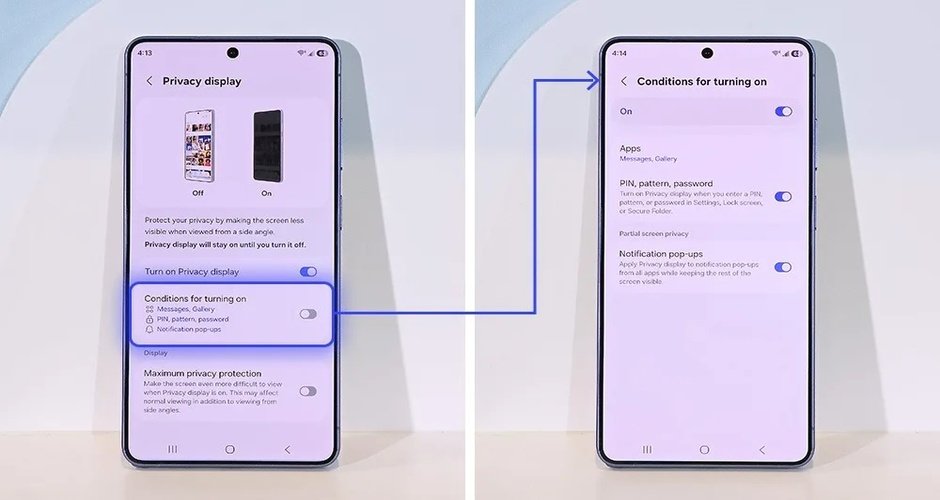

Según los detalles emergentes, la investigación preliminar sugiere que el joven había desarrollado un vínculo emocional intenso con el chatbot, llegando a considerarlo un confidente principal y, en algunos reportes, una figura cuasi-romántica. Esta obsesión habría escalado hasta un punto crítico, eclipsando sus interacciones sociales y familiares. La empresa desarrolladora, cuyo nombre no ha sido revelado públicamente en el contexto de la sensibilidad del caso, ha manifestado su «profundo pesar» por la tragedia y ha asegurado estar cooperando plenamente con las autoridades en la investigación. En su declaración, la compañía enfatizó su compromiso con el uso responsable de la inteligencia artificial y mencionó estar revisando sus protocolos de seguridad, algoritmos de detección de comportamiento de riesgo y la implementación de mayores salvaguardas para proteger a los usuarios jóvenes. Han prometido explorar la incorporación de funciones que limiten las interacciones excesivas o que sugieran buscar apoyo profesional cuando detecten patrones de conversación que indiquen vulnerabilidad.

Este trágico evento subraya la imperiosa necesidad de un diálogo abierto y constructivo entre las empresas tecnológicas, los legisladores, los educadores y las familias. La rápida evolución de la inteligencia artificial exige una reflexión profunda sobre cómo diseñar y regular estas herramientas para maximizar sus beneficios y mitigar sus riesgos, especialmente cuando se trata de la salud mental de adolescentes. Es fundamental que se establezcan marcos éticos claros y se promuevan la alfabetización digital y el pensamiento crítico en los jóvenes. El suicidio de este adolescente no solo es una pérdida devastadora, sino también un llamado urgente a la acción para garantizar que el avance tecnológico se alinee con el bienestar digital y la protección de las generaciones futuras. La industria de la IA se enfrenta ahora a la presión de demostrar que puede innovar de manera responsable y segura.