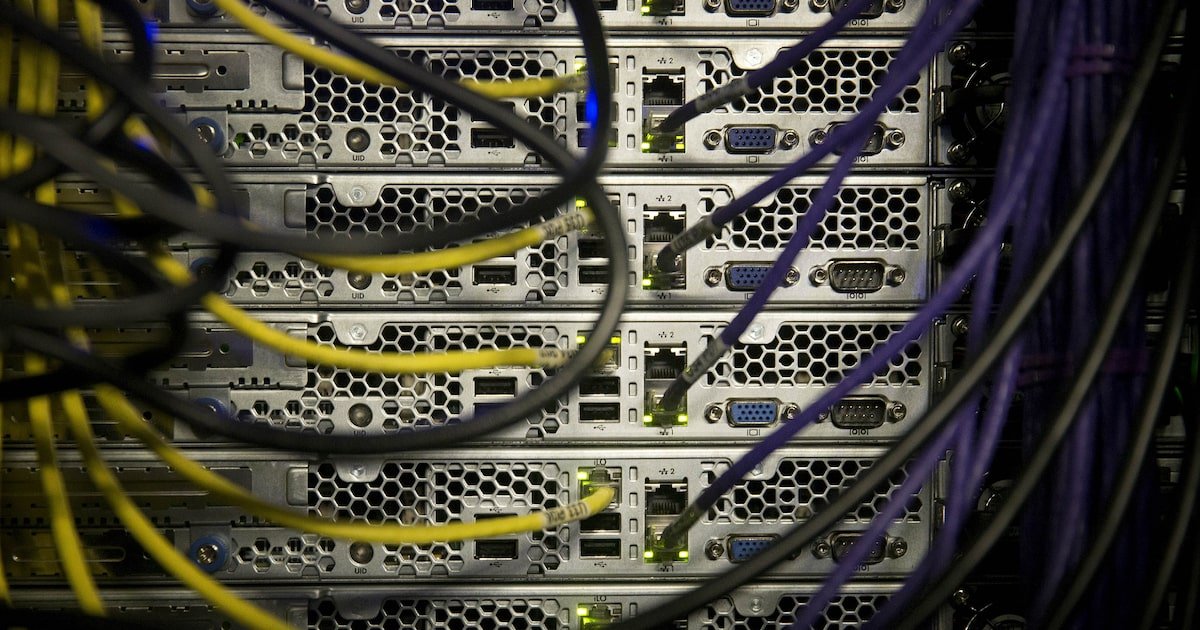

La convergencia de la Inteligencia Artificial (IA) y la estrategia militar está redefiniendo el futuro de la guerra, generando un intenso debate global sobre sus implicaciones éticas y operativas. En el centro de esta discusión se encuentra un notable «pulso» entre la visión de una administración liderada por el expresidente Donald Trump y una destacada empresa tecnológica, respecto a la aplicación sin límites de su tecnología en escenarios bélicos. Este conflicto no solo aborda cuestiones de seguridad nacional, sino que también pone de manifiesto la creciente tensión entre el avance tecnológico y las consideraciones morales en el ámbito de la defensa.

El contexto de este debate se sitúa en un periodo de rápida evolución tecnológica y una creciente militarización de la IA. Desde hace años, diversas potencias mundiales han invertido significativamente en el desarrollo de sistemas autónomos y semiautónomos, con el potencial de transformar la toma de decisiones en el campo de batalla. Esta carrera armamentística de la IA ha generado preocupaciones en la comunidad internacional y en el sector tecnológico, especialmente en lo referente a los sistemas de armas autónomas letales (LAWS, por sus siglas en inglés), que podrían seleccionar y atacar objetivos sin intervención humana significativa. La administración Trump, conocida por su enfoque en fortalecer las capacidades militares estadounidenses y asegurar una ventaja tecnológica, ha promovido en varias ocasiones el uso extensivo de innovaciones para la defensa, buscando mantener la primacía en un entorno geopolítico cambiante.

El epicentro de la controversia radica en la postura de una empresa tecnológica líder, que, consciente del poder disruptivo de sus algoritmos y sistemas de IA, ha expresado públicamente su renuencia a que su tecnología sea utilizada sin restricciones en contextos bélicos. Esta firma ha articulado principios éticos y políticas internas que buscan limitar la aplicación de su IA en armamento autónomo, especialmente en aquellas funciones que implican la toma de decisiones letales sin supervisión humana directa. Por otro lado, informes han sugerido que la administración del expresidente Trump habría presionado para flexibilizar o eliminar estas restricciones, argumentando la necesidad de una capacidad militar sin precedentes y una ventaja estratégica indispensable frente a adversarios. La administración habría enfatizado que cualquier limitación impuesta por empresas privadas podría comprometer la seguridad nacional y la capacidad de respuesta del país. Este desacuerdo pone de manifiesto una divergencia fundamental entre el imperativo de la innovación tecnológica y la responsabilidad social y ética de las corporaciones que la desarrollan.

En última instancia, el «pulso» entre la postura de la administración Trump y la empresa tecnológica subraya una de las cuestiones más apremiantes de nuestra era: cómo equilibrar el potencial transformador de la Inteligencia Artificial con la imperativa necesidad de establecer límites éticos y morales, especialmente en el ámbito de la guerra. La resolución de este conflicto, o la ausencia de ella, sentará un precedente significativo para el futuro del desarrollo tecnológico y su aplicación en la defensa global. A medida que la IA continúa su evolución, la comunidad internacional y los líderes políticos y empresariales deberán enfrentar el desafío de definir un marco que permita aprovechar sus beneficios mientras se mitigan los riesgos inherentes, garantizando que la autonomía tecnológica no eclipse la responsabilidad humana.